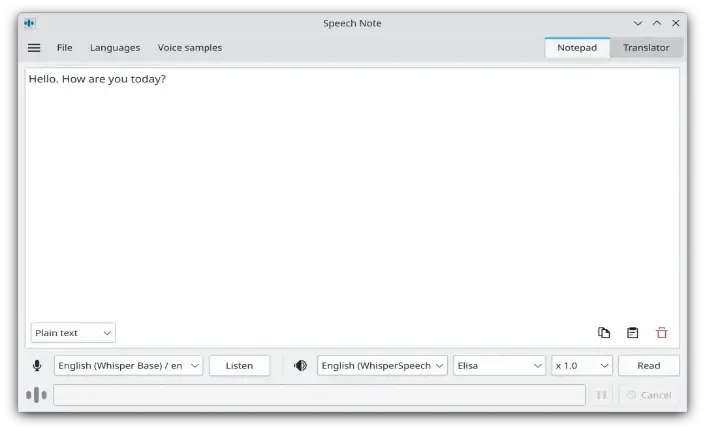

#Speech #Note – #Notizen und mehr -

Bei der Recherche für einen Artikel über #Text2Speech und #Speech2Text unter #Linux bin ich auf die kleine App Speech Note gestoßen, nicht zu verwechseln mit dem proprietären SpeechNotes. Insofern ist der Name nicht wirklich clever gewählt. Clever ist dagegen das Konzept der noch jungen Anwendung.

Speech Note ist eine vielseitige Anwendung für Notizen, die durch ihre Funktionen und Datenschutzorientierung hervorsticht.